Mit jedem Klick am Smartphone hinterlassen wir Datenspuren, mit denen die Unternehmen dann wirtschaften - aber oft wissen wir viel zu wenig darüber, sagt die Digitalethikerin Petra Grimm. Darüber, wie mehr ethisches Bewusstsein zu Bürgern und Betrieben kommt und warum Privatheit als Wert so wichtig ist, sprach sie im Podcast mit Rieke C. Harmsen und Christine Ulrich. Grimm ist Professorin für Medienforschung und Kommunikationswissenschaften an der Hochschule der Medien in Stuttgart und leitet das Institut für Digitale Ethik.

Frau Grimm, Sie sind seit 1998 Professorin und haben den Begriff der Digitalen Ethik mitgeprägt. Im selben Jahr wurde Google gestartet und sammelt seither fleißig Daten. Wie bewegen Sie sich durch die vernetzte Welt?

Petra Grimm: Die Perspektive der Ethik umfasst auch die Frage nach der persönlichen Wertehaltung. Ich selbst versuche im Alltag, so gut es eben geht, meine Privatheit zu schützen und den Markt der Möglichkeiten zu nutzen: Welche Dienste bieten mir Alternativen? Welche schützen einigermaßen gut meine Privatsphäre? Oder inwieweit versuchen sie, meine Daten zu sammeln und auszuwerten, um sie womöglich für ein Profiling (Profil-Erstellung) oder Social Scoring (soziales Punktesystem) zu nutzen? Ich persönlich nutze zum Beispiel kaum die Suchmaschine von Google, sondern verwende Startpage, das funktioniert genauso gut.

Die Digitalisierung ist sehr schnell, die Ethik denkt gründlich nach - wie soll sie Schritt halten?

Grimm: Digitalisierung und Ethik sind wie Hase und Schildkröte. Der Hase ist schnell, aber die Schildkröte - die übrigens für Klugheit und Weisheit steht - ist trotzdem schneller am Ziel.

In der Fabel verhöhnt der Hase die Schildkröte, die ihn daraufhin zum Rennen fordert. Der Hase ist so siegesgewiss, dass er zwischendurch ein Nickerchen macht. Die Schildkröte gewinnt, indem sie langsam, aber stetig läuft.

Grimm: Nun ja, die Schildkröte ist besonnen und stellt sich den Herausforderungen. In der Digitalen Ethik befassen wir uns auch mit neuen Herausforderungen, die sich durch die neuen Technologien ergeben, wie etwa mit deren sozialen und ethischen Bedeutungen und Auswirkungen. So ist etwa die Folgenabschätzung bei Big Data und Künstlicher Intelligenz viel schwieriger geworden, kausale Zusammenhänge und Verantwortungsstrukturen sind komplexer geworden. Die Ethik muss dieser Entwicklung Rechnung tragen und sich neuen ethischen Aspekten widmen, wie etwa der Frage, ob sich unser Menschenbild verändert, wie eine wertebasierte Gestaltung von Produkten und Dienstleistungen aussieht und vieles mehr.

Besteht trotzdem die Gefahr, dass die Ethik das Rennen verliert?

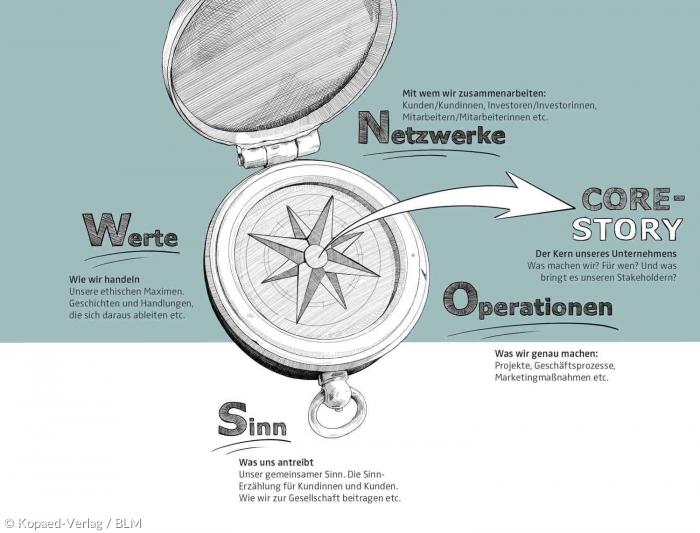

Grimm: Ethische Kriterien können in der Praxis schon von Beginn an, also bei der Entwicklung von Geschäftsideen, implementiert werden. Diesen Ansatz nennt man "Ethics by Design". Dabei wird nicht im Nachhinein noch versucht, ethische Aspekte zu berücksichtigen, sondern diese sind bereits in der Ideenentwicklung Bestandteil des Geschäftsmodells. Wichtig ist hierbei, die Perspektiven aller Betroffenen zu berücksichtigen und sich als Unternehmen die richtigen Fragen zu stellen, zum Beispiel: Für welche Werte stehen wir? Welche Konflikte gibt es, wenn die Perspektiven aller Stakeholder berücksichtigt werden? Wie können wir fair, transparent und nachvollziehbar die Dienste gestalten?

Wie kommt die Ethik in die Unternehmen ?

Sie haben kürzlich "Start-up with Ethics" veröffentlicht, ein Arbeitsbuch für Jungunternehmen. Hemmen ethische Bedenken nicht Innovation und Erfolg?

Grimm: In einem Forschungsprojekt für die Bayerische Landeszentrale für neue Medien (BLM) haben wir Start-ups aus der Medienbranche zu Ethics by Design befragt und eine Methode entwickelt, mit der Start-ups selbst diesen Prozess konkret durchführen können. Dazu entstand ein Handbuch, das als praktischer Leitfaden dient. Dass es sich auch im wahrsten Sinne des Wortes lohnt, sich eine ethische Expertise anzueignen, zeigt die Praxis: Ein Beispiel hierfür ist die smarte Spielzeugpuppe "Cayla". Sie hatte im Unterschied zu anderen internetfähigen Puppen keinen Ausschaltknopf und zeigte nicht an, dass sie Gespräche aufnahm, sie war "always on" - sie wurde von der Bundesnetzagentur als Spionage-Tool eingeschätzt, weil sie Gespräche aufzeichnen und an die Hersteller übermitteln konnte. Dabei hätte es in der Entwicklung nur ein paar Cent gekostet, einen Ausschaltknopf einzubauen. Aber so musste die Puppe vom Markt verschwinden, die Eltern wurden sogar aufgefordert, sie zu zerstören.

Im Frühjahr wollten deutsche Start-up-Gründer ein Produkt namens "Pinky Gloves" auf den Markt bringen: rosa Plastikhandschuhe für Frauen, die darin Menstruationsartikel entsorgen können. Das Projekt scheiterte in einem Shitstorm. Warum?

Grimm: Es ist gescheitert, weil nicht die Perspektive der Betroffenen, als der Verbraucherinnen, ausreichend miteinbezogen und das Produkt an ihren Bedürfnissen vorbei entwickelt wurde. Das ist ein wichtiger ethischer Aspekt: nicht nur die eigene Perspektive im Kopf zu haben, sondern die Interessen, Bedürfnisse und Werte der verschiedenen Stakeholder, also der Beteiligten, miteinzubeziehen. Sich für Ethics by Design zu entscheiden, kann also auch ökonomisch ein Wettbewerbsvorteil sein.

Sind die Menschen sensibilisiert für Ethik und bereit, sie zu implementieren?

Grimm: Ich bin überzeugt, dass wir eine ethische Trendwende verzeichnen. Schon 2018 sagten bei einer Befragung deutscher Digitalunternehmen mehr als 70 Prozent, dass ihnen ethische Standards wichtig seien. Das Bewusstsein ist dort längst angekommen. Das Problem besteht oft eher in der Umsetzung, aber auch bei den Entscheidungsträgern und komplexen Verantwortungs- und Machtstrukturen.

Wichtig ist aber auch, inwieweit die Kunden es schätzen, dass Produkte werteorientiert und nachhaltig sind und das aktiv nachfragen. Wie wichtig ist es mir als Verbraucher, dass meine Privatheit geschützt wird oder dass ich transparent angezeigt bekomme, was im Hintergrund abläuft? Vielen Nutzerinnen und Nutzern ist oft noch nicht klar, was unter der Oberfläche mit ihren Daten passiert. Man hat ein mulmiges Gefühl, aber keine genaueren Informationen. Und im schlimmsten Fall resignieren die Nutzer oder nehmen eine nihilistische Haltung ein, wie unsere aktuelle Studie zu den Werten, Ängsten und Hoffnungen in der digitalen Alltagswelt gezeigt hat.

Ist das ein Kennzeichen der digitalen Gesellschaft, dass sie noch relativ unwissend und unentschieden unterwegs ist? Warum verzögert sich hier der ethische "turn", und wie kommt mehr Bewusstsein zu den Bürgern?

Grimm: Eine Förderung von Digitalkompetenz ist zwar wichtig, aber noch viel mehr die Schaffung entsprechender Rahmenbedingungen durch eine Regulierung. In Europa sind wir mit der Datenschutzgrundverordnung ja schon ein Stück nach vorne gekommen - übrigens ein Modell, das auch für andere Länder Vorbildfunktion hatte. Wenn es um das Thema Künstliche Intelligenz geht, dann sind wir ebenfalls gefordert. Wie können wir angesichts der Entwicklungen in China und den USA die digitalen Technologien so gestalten, dass sie eine wertebasierte Mensch-Technik-Interaktion ermöglichen und unsere demokratischen Werte widerspiegeln? Wenn uns ein solches Alternativmodell gelänge, könnte das auch ein Wettbewerbsvorteil sein.

Welche Rolle spielen die großen Tech-Unternehmen?

Grimm: Das Image der großen Tech-Unternehmen leidet zunehmend, im Unterschied zu vor zehn oder 15 Jahren, wo die Euphorie und Erwartungshaltung an die neuen Medien und Dienste groß war. Die Geschäftsmodelle der US-Digitalmonopole wie Alphabet (Google, Youtube), Facebook, Amazon oder Microsoft beruhen auf der wirtschaftlichen Ausbeute der personenbeziehbaren Daten.

Diese Tech-Unternehmen verfügen mittlerweile über eine Machtkonzentration, die ohnegleichen in der Geschichte ist. Sie besitzen ein unbeschreiblich großes Wissen über uns und sind meinungsbildungsrelevant; letztlich können sie auch dazu genutzt werden, politische Wahlen zu beeinflussen.

Umso wichtiger ist die Förderung von Informations- und Meinungsbildungskompetenz.

Grimm: Die aktuelle Pisa-Studie zeigt, wie schwer sich Schüler tun, eine Meinung von Fakten zu unterscheiden und Desinformation zu erkennen. Viel grundsätzlicher geht es auch darum, zu verstehen, warum Meinungsvielfalt und Meinungsfreiheit sowie eine freie Presse wichtig für die Demokratie sind.

Wir brauchen mehr Materialien und Angebote in den Schulen, damit Pädagogen dieses Wissen vermitteln können und Schüler sich eine fundierte Haltung aneignen können. Deshalb haben wir vom Institut für Digitale Ethik zusammen mit der EU-Initiative "klicksafe" ein Handbuch zur Meinungsbildung in der digitalen Welt erstellt.

Warum ist Privatheit ein so zentraler Wert? Warum beeinträchtigt es meine menschliche Freiheit, wenn meine Daten verfügbar werden?

Grimm: Privatheit ist universaler Wert, auch wenn er kulturell variabel gelebt und interpretiert wird. Privatheit bedeutet, kontrollieren zu können, wer die Grenze zu meiner privaten Lebenswelt überschreiten darf und wer nicht. Im informationellen Sinn bedeutet Privatheit, dass ich kontrollieren kann, wer was in welchem Zusammenhang über mich weiß. Letztlich geht es um die Fragen von Autonomie und Freiheit: dass ich selbstbestimmt entscheiden kann, wem ich meine privaten, vielleicht intimen Gedanken zukommen lasse und wem nicht.

Privatheit kann auch ein geschützter Raum sein, in dem ich mit anderen kommuniziere und meine privaten Gedanken austausche, oder meine Geheimnisse - etwa mein Tagebuch - für mich behalte. Letztendlich brauche ich Privatheit, um frei entscheiden und handeln zu können. Wer keine Privatheit besitzt, ist dem System ausgeliefert. Denn wer viel über mich weiß, kann mich leichter in seinem Sinne beeinflussen und womöglich manipulieren.

Indem wir immer mehr Daten preisgeben, lassen wir uns auch bewerten.

Grimm: Wenn Verbraucher heute ein Produkt oder eine Flugreise online bestellen, kann es sein, dass sie unterschiedliche Preise angezeigt bekommen. Dabei handelt es sich um das "dynamic pricing". Je nachdem, wo jemand wohnt und welches Gerät er oder sie benutzt, ob Apple oder Android, kann der Preis anders gestaltet sein. Die Preisgestaltung ist dem Unternehmen überlassen.

Problematischer wird es, wenn es sich um die Vergabe von Darlehen und Krediten oder die Prämiengestaltung bei Versicherungen handelt. Gesteigert wird das Ganze dann, wenn Mitarbeitende ihre Fitnessdaten und Daten zu sonstigen Gewohnheiten preisgeben müssen, wie es in einigen Ländern schon stattfindet. Grundsätzlich ist aber die Zusammenführung von unterschiedlichen Datensätzen ein Problem, also zum Beispiel, wenn Finanzdaten, Gesundheitsdaten oder Kontaktdaten zusammen ausgewertet werden können.

Bei Bewerbungsgesprächen wird bereits mit digitaler Gesichtserkennung experimentiert. Braucht es mehr Diskussion dazu?

Grimm: Gesichtserkennung, also Face Analytics, gewinnt an Bedeutung, gerade bei Einstellungsverfahren. Wer sich heute auf einen Job bewirbt, wird eventuell zuerst mit einer künstlichen Intelligenz konfrontiert. Wie ein Experiment des Bayerischen Rundfunks gezeigt hat, bietet ein Start-up bereits ein KI-System an, mit dem die selbstproduzierten Videos von Bewerbern ausgewertet werden.

Die Vermutung, dass die KI objektiver oder neutraler sei als ein Mensch, konnte sich allerdings nicht bestätigen. Ein Test der Software zeigte: Je nach Outfit ändert sich die Bewertung - zum Beispiel schätzt die KI die Bewerberin um zehn Punkte weniger gewissenhaft ein, wenn sie eine Brille trägt. Trägt sie ein Tuch um den Kopf, dann wird sie als offener, gewissenhafter und weniger neurotisch eingeschätzt als im Original.

Auch Hintergrund und Beleuchtung können das Ergebnis beeinflussen. Hier stellen sich grundsätzliche Fragen wie etwa: Sollten künstliche Systeme zur Bewertung überhaupt eingesetzt werden? Warum vertrauen wir den Maschinen mehr als der Entscheidung von Menschen? Und: Welches (simple) Menschenbild verbirgt sich hinter den Beurteilungskriterien?

Das klingt mehr als unfair.

Grimm: In der Tat ist die Frage nach Fairness und Diskriminierung eine zentrale, wenn es um Künstliche Intelligenz geht. Darüber hinaus ist aber auch der Bildungsfaktor relevant. So könnten digitale Technologien auch zur Verfestigung von Chancenungleichheit führen: Diejenigen, die sich mit den Technologien besser auskennen, können sich besser schützen oder sogar das System überlisten, während diejenigen, denen es an Bildung fehlt, dem System ausgeliefert sind. Wer beispielsweise weiß, wie Bewerbungsvideos möglichst vorteilhaft gestaltet werden sollten, wird einen deutlichen Vorteil haben.

Was raten Sie Ihren Studierenden?

Grimm: Für mich ist der Ansatz der Integrierten Lehre wichtig. Das heißt, unterschiedliche Perspektiven, wie ethische, wirtschaftliche und technische, zusammenzuführen. Wichtig ist es, Studierende für ethische Fragen zu sensibilisieren. Wir diskutieren zum Beispiel, ob Roboter menschlich aussehen sollen oder ob Maschinen moralisch handeln können. In einem Think Tank befassen wir uns auch mit Zukunftsszenarien und der Sinnhaftigkeit von digitalen Technologien für die Menschen.

Mein Ansatz ist, Ethik anwendungsnah zu reflektieren, aber auch die richtigen Methoden zu nutzen. Deshalb finde ich den Ansatz der Narrativen Ethik so attraktiv: Filme, Anwendungsfälle, also Geschichten aller Art zu nutzen, um ethische Konflikte herauszuarbeiten. Doch es geht nicht nur um Reflexion und Faktenwissen: Die Studierenden sollen auch eine Haltung entwickeln, also begründen können, warum sie sich so und nicht anders verhalten. Eine Haltung zeigt sich im Handeln, nicht in Worten.

Thema Gewalt - Cybermobbing, Hatespeech, Gewaltdarstellungen in Spielen: Wie steht es hier um die Medienkompetenz der Jugendlichen?

Grimm: Diese Beispiele für Online-Gewalt sind sehr unterschiedlich gelagert. Ebenso können wir nicht von den Jugendlichen verallgemeinernd sprechen. Beim Thema Cybermobbing sind vor allem Gewaltprävention an Schulen und entsprechende Strukturen besonders wichtig. Auch die Unterstützung durch Peer-to-Peer-Projekte wie etwa das Angebot der Medienscouts von "juuuport" sind hilfreich.

Wir haben auch Schulmaterialien in dem Handbuch "Ethik macht klick" erstellt, in dem wir mithilfe der von uns entwickelten "Medienethischen Roadmap" zeigen, wie ein Reflexionsprozess über Cybermobbing möglich ist. In den Blick sollte man auch die Struktur der Sozialen Medien nehmen: Der digitale Kosmos, in den junge Nutzer hineingeboren werden, ist von ökonomischen Prinzipien geprägt. Für Kinder und Jugendliche ist dieser Kosmos, den sie in den Sozialen Medien erleben, selbstverständlich. Diese geben die Struktur vor, wie man kommuniziert und wie man sich präsentieren soll. Dazu gehört auch ein Wettbewerb um Anerkennung.

Kinder und Jugendliche werden durch Soziale Medien zu einem ständigen Bewerten und Vergleichen sozialisiert. So werden sie auch dazu veranlasst, ihre persönlichen Informationen und Bilder preiszugeben und damit Einblick in ihre Privatsphäre zu geben. Damit erhöht sich allerdings ihr Verletzungsrisiko, etwa wenn andere sich über sie lustig machen oder sie gar mobben. Eine weitere Herausforderung ist der Zugang zu problematischen Inhalten. Kinder und Jugendlich können im Netz allgemein und nicht nur in Spielen mit unterschiedlichen Inhalten wie Pornografie oder Gewalt konfrontiert werden, ohne sich gut schützen zu können.

Was braucht es hier Ihres Erachtens?

Grimm: Neben den Maßnahmen zur Gewaltprävention und medienethischen Kompetenzförderung müssen wir auch direkte Kommunikationsfähigkeit fördern. Nicht nur bei Heranwachsenden, auch bei Erwachsenen ist ersichtlich, dass bei Konflikten der mediale und damit distanzierte Kommunikationsweg, etwa via WhatsApp, häufig genutzt wird. Damit sind aber Missverständnisse vorprogrammiert, denn im Unterschied zur direkten Kommunikation kann ich bei der indirekten nicht so gut wahrnehmen, wie mein Gegenüber direkt auf mich reagiert.

Wenn ich jemandem face to face gegenüberstehe, bekomme ich mit, was es für Folgen hat, wenn ich einen unbedarften Satz sage: Dann sehe ich gleich beim anderen, dass er dies möglicherweise missverstanden hat und sich verletzt fühlt. Online merke ich das nicht sofort. Missverständnisse sind viel schneller möglich und daraus können sich emotionale Dynamiken entwickeln.

Was braucht es noch für Gewaltprävention?

Grimm: Hilfreich sind auch Geschichten und der Fokus auf die Bystander, also diejenigen, die Zeugen von Cybermobbing sind. Wir haben hierzu im Forschungsprojekt "Prädisiko", bei dem es um die Prävention durch Kommunikation ging, mitgearbeitet. Eine Erkenntnis war, dass man mit bestimmten Videostorys für das Thema "Cybermobbing" in den Sozialen Medien erfolgreich sensibilisieren, Handlungsalternativen aufzeigen und die Bystander erreichen kann.

Denn diese sind die entscheidende "Masse", sie können den Täter isolieren - oder ihn unterstützen, indem sie nichts tun. Man sollte vor allem diejenigen erreichen, die das Ganze mitverfolgen, aber nicht einschreiten und es dadurch geschehen lassen. Ein weiteres Projekt, mit dem wir auch das Thema Cybermobbing adressieren, sind die "Zehn Gebote der Digitalen Ethik". Hier geht es erstmal nur darum, einen Impuls für eine Reflexion über Cybermobbing zu setzen.

Man muss also diese kritische Masse dazu bekommen, medienkompetent zu werden, indem die "Zehn Gebote" beherzigt werden. Welche Geschichten werden da erzählt?

Grimm: Die "Zehn Gebote der Digitalen Ethik" sind nur ein kleiner Meilenstein. Allerdings haben sie einen großen Effekt erzielt und wurden vielfach von Schulen angefragt. Es handelte sich um ein Projekt mit Masterstudierenden, das nun auch einen Relaunch und Aktualisierung erfahren hat. In diesen zehn Geschichten geht es ist es um vielfältige ethische Themen, etwa um Desinformation.

Die Geschichte bezieht sich auf das dritte Gebot: "Glaube nicht alles, was du online siehst, und informiere dich aus verschiedenen Quellen." Es ist ein sehr aktuelles Gebot, wenn man etwa an die Corona-Verschwörungserzählungen denkt. In dieser Geschichte ist Max die Hauptfigur: "Nach seinem Abitur will Max durch Südamerika reisen. Schon mehrere Monate vor Reisestart beginnt er mit der Planung und kommt mit dem Thema Impfungen in Berührung. Das Auswärtige Amt empfiehlt dringend eine Gelbfieberimpfung, da Stechmücken dort tödliche Infektionen übertragen können. Max erinnert sich an ein Youtube-Video, das er vor einigen Tagen gesehen hat. In diesem behauptet ein Arzt, dass bestimmte Impfungen zu gravierenden Nebenwirkungen wie Autismus führen können. Max entscheidet sich deshalb gegen eine Impfung. Schnell verbreitet sich Max' Meinung in seiner Klasse.

Daraufhin schickt ihm sein bester Freund mehrere Links zu wissenschaftlichen Studien, die die Behauptung des Arztes als Falschmeldung enttarnen. In Zukunft will sich Max vielseitiger und kritischer informieren." Anhand dieser simplen Geschichte kann man Reflexionsfragen stellen: Warum glaubt Max diesem Youtube-Video? Und warum ist es wichtig, dass man nach Wahrheit sucht? Was würde man tun, wenn man selbst in der Lage wie Max' Freund wäre? Die Geschichten sollen an die eigene Lebenswirklichkeit anschlussfähig sein und somit motivieren, sich überhaupt mit ethischen Fragen zu beschäftigen.

Blicken Sie optimistisch oder pessimistisch in die digitale Zukunft?

Grimm: Von Natur aus bin ich eher optimistisch und sehe die Dinge nicht in Schwarz-Weiß. Mir erscheint oftmals der goldene Mittelweg als der sinnvollste. Wenn ich mir die Zukunftsszenarien zur Digitalisierung ansehe, kann ich aber wieder nur eine Dichotomie der Narrative erkennen. Wie wir die Welt verstehen, hängt maßgeblich davon ab, welche Erzählungen, also Narrative, wir Phänomenen und Entwicklungen zuschreiben. Narrative beeinflussen unsere Sicht auf die Welt und unser ethisches oder unethisches Verhalten.

Die mit der Digitalisierung und KI aktuell verbunden Hoffnungen, Erwartungen und Ängste lassen sich auf zwei Meta-Narrative reduzieren: Ich nenne sie das Heilige-Gral-Narrativ und das Büchse-der-Pandora-Narrativ. Das Heilige-Gral-Narrativ erzählt uns die Geschichte der Digitalisierung als eine, die unsere großen Probleme lösen wird. Sie verspricht neue Wertschöpfungsmodelle. Wenn wir sie nicht schnellstmöglich für Geschäftsmodelle fruchtbar machen, dann werden wir im Wettbewerb mit anderen Ländern, vor allem den USA und China, abgehängt. Die Internetkonzerne versprechen uns, dass Digitalisierung und KI mehr Lebensqualität und Komfort bieten. Einige glauben sogar an eine Superintelligenz, die irgendwann dem Menschen überlegen sein könnte.

Und die pessimistische Sicht?

Grimm: Das Pandora-Narrativ erzählt uns dagegen die Digitalisierung als Bedrohung. Hier werden Ängste artikuliert, die zum Teil berechtigt, zum Teil unberechtigt sind. So wird ein möglicher Kontrollverlust befürchtet, ebenso der Verlust von Arbeitsplätzen, aber auch die Risiken der Überwachung und Manipulation werden in diesem Narrativ artikuliert. Schließlich wird befürchtet, dass sich das Master-Slave-Modell umkehrt und wir am Ende diejenigen sind, die sich der Maschine anpassen müssen.

Wie handeln wir als Bürger verantwortlich?

Grimm: Das ist keine leichte Frage. Verantwortung kann ich nur für etwas oder jemanden übernehmen, sofern ich einen Handlungsspielraum habe und für mein Handeln verantwortlich gemacht werden kann. In der digitalisierten Alltagswelt begegnet jede Person in vielfältiger Weise Situationen, in denen es um verantwortungsvolles Handeln geht: wenn wir mit anderen kommunizieren, wenn wir Bilder und Nachrichten teilen oder wenn wir in konfliktreiche Situationen geraten, zum Bespiel Hass, Mobbing oder Desinformation erleben.

Wichtig erscheint mir, dass wir Möglichkeiten suchen, die Entwicklung der digitalen Technologien mitzugestalten und dort widerstandsfähig zu sein, wo wir uns unter Druck gesetzt fühlen. Wir sollten auch versuchen, Konflikte möglichst direkt und nicht medial auszutragen sowie bereit zu sein, dem anderen zuzuhören. Statt eines Schlagabtauschs wäre es wichtig, wieder mehr Dialoge zu führen, die auf guten Argumenten und weniger Affekten basieren.

Podcast Ethik Digital

Der Podcast "Ethik Digital" von Rieke C. Harmsen und Christine Ulrich kann bei diesen Kanälen abonniert werden:

Fragen und Anregungen mailen Sie bitte an: rharmsen@epv.de

Wie bekommen wir Ethik in die Unternehmen?

Privatheit, Verantwortung, Gleichheit sind Begriffe, die im Zusammenhang mit ethischen Standards oft verwendet werden. Doch wie können diese Werte in die Praxis umgesetzt werden? Das Buch "Start-Up with Ethics" zeigt, wie es geht.